2025: Das erste Jahr der KI-Regulierung in Europa — Bilanz und Blick nach vorn

Der EU AI Act ist die weltweit erste umfassende Verordnung zur Regulierung von künstlicher Intelligenz (KI). Mit seinem risikobasierten Ansatz soll er KI sicher, vertrauenswürdig und regelkonform gestalten. Damit markiert die Verordnung 2025 einen Wendepunkt für die europäische KI-Landschaft: Was der EU AI Act bereits verändert hat, wo Herausforderungen bestehen und welche Entwicklungen Unternehmen in den kommenden Jahren erwarten.

- Chronologischer Rückblick auf das Jahr 2025 - Was ist passiert?

- Erste Auswirkungen auf Praxis, Wirtschaft und Regulierung

- Technische und rechtliche Baustellen – was 2025 noch offengeblieben ist

- Von 2026 bis 2030: Wie sich die KI-Regulierung in Europa weiterentwickelt

- Fazit: 2026 wird zum entscheidenden Jahr für KI-Compliance

Chronologischer Rückblick auf das Jahr 2025 – Was ist passiert?

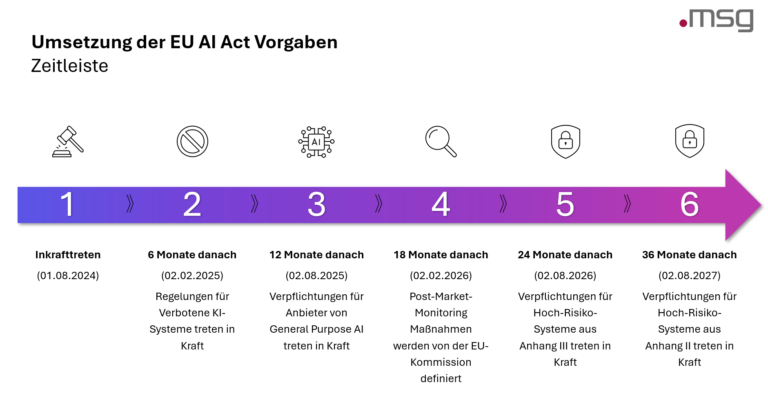

Mit der Veröffentlichung des EU AI Acts am 8. August 2024 hat die Europäische Union das weltweit erste umfassende und rechtlich verbindliche Regelwerk für den Einsatz künstlicher Intelligenz (KI) geschaffen. Als Bestandteil eines umfassenden Pakets politischer Maßnahmen, ist es das Ziel des EU AI Acts die Vertrauenswürdigkeit der neuen und sich rasant entwickelnden Trendtechnologie zu stärken und Sicherheit, Grundrechte sowie menschenzentrierte KI innerhalb der EU zu gewährleisten.

Mit Hilfe von vier Risiko-Kategorien (verbotenes Risiko, Hoch-Risiko, geringes Risiko, minimales Risiko) verlangt der EU AI Act von KI-Systemen künftig Sicherheitsmaßnahmen und stellt entsprechende Anforderungen an diese.

Erste Vorschriften sind in diesem Jahr bereits in Kraft getreten. So ist beispielsweise der Einsatz verbotener KI-Systeme, wie etwa Systeme zur biometrischen Gesichtserkennung in Echtzeit, seit dem 2. Februar 2025 untersagt.

Auch Unternehmen stehen seit dem 2. Februar 2025 stärker in der Verantwortung. Wer KI-Systeme einsetzt, muss Mitarbeitenden eine qualifizierte KI-Kompetenzvermittlung anbieten. Artikel 4 des EU AI Acts definiert dazu klar, dass Anbieter und Betreiber sicherstellen müssen, dass ihre Beschäftigten über ausreichende Kenntnisse und Fähigkeiten im Umgang mit KI verfügt.

KI-Kompetenzschulung gemäß EU AI ActMachen Sie Ihr Team fit für die Zukunft!

Unsere interaktive Schulung vermittelt Ihnen praxisnahdie notwendigen Kenntnisse, um KI-Systeme rechtskonformund effizient in Ihrem Unternehmen einzusetzen.

Am 2. Mai 2025 veröffentlichte die EU-Kommission die sogenannten KI-Verhaltenskodizes. Sie dienen als praktische Leitlinien, wie Anbieter von KI-Systemen freiwillig nachweisen können, dass sie bereits vor der vollständigen Anwendung des Gesetzes hohe Standards bei Transparenz, Qualität, Risikomanagement und Sicherheit einhalten. Diese Kodizes sollen Unternehmen unterstützen, frühzeitig eine verantwortungsvolle KI-Governance zu etablieren und regulatorische Anforderungen planbar umzusetzen.

Im August 2025 traten zudem spezifische Vorschriften für KI-Modelle mit allgemeinem Verwendungszweck beziehungsweise General Purpose Artificial Intelligence (GPAI) in Kraft. Anbieter von großen KI-Modellen wie beispielsweise GPT von OpenAI sind nun verpflichtet, umfangreiche Transparenzmaßnahmen umzusetzen, Risiken zu bewerten und die Einhaltung von Urheberrechten sicherzustellen. Bei möglichen systemischen Risiken gilt darüber hinaus eine Meldepflicht gegenüber den zuständigen europäischen Behörden. Ziel dieser Maßnahmen ist es, die Sicherheit leistungsfähiger KI-Modelle zu erhöhen und gleichzeitig Innovation zu ermöglichen.

Parallel dazu hat die EU ein mehrstufiges Governance-Modell eingeführt. Auf europäischer Ebene sind neue Gremien und Anlaufstellen, wie etwa das EU-Amt für künstliche Intelligenz entstanden, das künftig eine koordinierende Rolle übernimmt. In Deutschland wurden ebenfalls nationale Aufsichtsstrukturen benannt: Die Bundesnetzagentur (BNetzA) übernimmt zukünftig die zentralen Aufgaben der Marktüberwachung und setzt die Anforderungen des AI-Acts durch. Branchenbezogene Behörden, wie etwa die BaFin, ergänzen diese Aufsicht in ihren jeweiligen Sektoren.

Insgesamt ist damit bereits ein klar definiertes System der Verantwortlichkeit und Aufgaben für sicheren und rechtskonformen KI-Einsatz in Europa entstanden.

Erste Auswirkungen auf Praxis, Wirtschaft und Regulierung

Bereits in den vergangenen beiden Jahren zeigte sich ein deutlicher Aufwärtstrend beim Einsatz von KI im Bankensektor. Besonders im Rückblick auf das Jahr 2025 wird deutlich, wie stark sich die Nutzung von KI-Technologien mittlerweile etabliert hat. Banken betonen dabei vor allem die geschäftlichen Vorteile, die von der Beschleunigung operativer Prozesse über präzisere Bewertungen bis hin zu einem verbesserten Kundenkontakt reichen. Dieser Trend machte im Jahr 2025 klar, dass KI längst keine Zukunftsvision mehr ist, sondern einen festen Platz im täglichen Geschäftsbetrieb gefunden hat.

Gleichzeitig rückten spätestens mit dem Inkrafttreten der Verordnung für verbotene KI-Systeme auch die herannahenden regulatorischen Fristen stärker ins Bewusstsein der Institute.

Neben der Implementierung und Einführung von neuen KI-Systemen in den Geschäftsalltag der Banken sind damit auch die Themen KI-Governance, Compliance und Risikomanagement zunehmend kritischer für den Sektor geworden.

Lisa Weinert Managerin | Artificial Intelligence | msg for banking

Viele Banken haben daher bereits mit der Etablierung von KI-Governance in die bestehenden Strukturen begonnen und arbeiten an verschiedenen Maßnahmen wie etwa dem Entwurf von speziellen Richtlinien, der Ausarbeitung von Verantwortlichkeitskonzepten, der Schaffung neuer Rollen wie etwa dem „Chief AI Officer“ und der Erweiterung bestehender Kontrollmechanismen beispielsweise entlang des Three-Lines-of-Defense-Modells.

Darüber hinaus lassen sich bereits erste Versuche erkennen, durch ein gezieltes Self-Assessment die Risikokategorien der entwickelten und eingesetzten KI-Systeme zu bestimmen und so potenziell risikoreiche Anwendungen noch vor dem Eintritt weiterer regulatorischer Anforderungen, zum Beispiel durch den EU-AI Act am 2. August 2026, zu identifizieren.

Im Bankensektor betrifft die Einstufung als Hoch-Risiko-System vor allem Anwendungen wie das automatisierte Kredit-Scoring. Anbieter und Betreiber solcher Systeme müssen hier umfangreiche regulatorische Vorgaben umsetzen, die unter anderem ein strukturiertes Risikomanagement, ein Qualitätsmanagement sowie menschliche Aufsicht vorsehen. Diese Anforderungen erfordern einen rechtzeitigen organisatorischen und technischen Vorlauf.

Auch die europäische Aufsichtsbehörde setzt für die Zukunft ein klares Signal: KI wird als wesentlicher Bestandteil der digitalen Transformation des Bankensektors auf der Agenda weit oben platziert. Auf nationaler Ebene beobachtet insbesondere die BaFin den Einsatz von KI im Finanzsektor, etwa für Kredit-Scoring, Betrugserkennung oder Zahlungsverkehr, und wird ihre aufsichtsrechtlichen Erwartungen an Governance, Risikomanagement, Datensicherheit und interne Kontrollen weiter konkretisieren. Es ist daher davon auszugehen, dass das Thema zukünftig intensiv überwacht und begleitet wird. Für Banken bedeutet das, sich künftig auf zusätzliche Anforderungen und Prüfungen einzustellen. Eine vorausschauende und umfassende Beschäftigung mit KI-Governance, Compliance und Risikomanagement bleibt daher unerlässlich.

Regulatorische Klarheit:KI im Einklang mit BAIT, EU AI Act, DSGVO & Co.

In unserer AI Coffee Break am 30. Januar 2025 erfahren Sie,wie Sie KI nahtlos in Ihr bestehendes Anforderungsmanagementintegrieren können - und warum die Regulatorik nicht die eigentlicheHerausforderung einer erfolgreichen KI-Strategie darstellt.

Technische und rechtliche Baustellen – was 2025 noch offengeblieben ist

Obwohl der EU AI Act nun seit etwas mehr als einem Jahr in Kraft ist und viele seiner Vorgaben bereits Anwendung finden, gibt es weiterhin offene Fragen sowie erste Kritiken an seiner praktischen Umsetzbarkeit.

Eines der zentralen Probleme ist die sehr weit gefasste Definition von KI-Systemen, die es Unternehmen und Behörden erschwert, eindeutig zu bestimmen, für welche KI-Systeme die jeweiligen Pflichten der Verordnung gelten.

Eine weitere Herausforderung ergibt sich aus der rasanten technologischen Entwicklung, die den Gesetzgebungsprozess teilweise überholt und das Risiko regulatorisch blinder Flecken erhöht.

Gleichzeitig fehlen bislang konkrete technische Vorgaben und Normen, die beispielsweise in den Bereichen Data Governance, Robustheit, Transparenz oder im Risiko- und Qualitätsmanagement Hilfestellung liefern können. Diese Lücken führen zu erheblichen Unsicherheiten bei der praktischen Umsetzung und Compliance.

Hinzu kommt, dass der EU AI Act stark auf Selbstzertifizierungen statt auf unabhängige Kontrollen der KI-Anbieter setzt. Dies kann zu Defiziten bei Aufsicht, Qualitätssicherung und Haftung führen und erhöht die Unsicherheit auf Unternehmensseite zusätzlich.

Diese und weitere Baustellen in den bestehenden regulatorischen Vorgaben lassen offen, wie die EU künftig damit umgehen wird und welche zusätzlichen Anforderungen in den kommenden Jahren möglicherweise noch auf Unternehmen zukommen werden.

Von 2026 bis 2030: Wie sich die KI-Regulierung in Europa weiterentwickelt

In Zukunft stehen Unternehmen in Europa vor einem deutlichen Wandel im regulatorischen Umgang mit künstlicher Intelligenz. Während die ersten Bestimmungen des EU AI Acts bereits umgesetzt sind, beginnt ab 2026 nun eine Phase, in der zentrale Pflichten schrittweise verbindlich werden und der Aufbau einer umfassenden KI-Governance in der EU vorangetrieben wird.

Bis 2026 liegt der Fokus vor allem auf der Konkretisierung technischer Anforderungen, dem Aufbau nationaler Aufsichtsstrukturen und der Einführung transparenter Melde- und Berichtspflichten.

Hannah Gürsching Analyst | Artificial Intelligence | msg for banking

Gleichzeitig werden Anbieter von General-Purpose-AI auf strengere Anforderungen vorbereitet, etwa in Bezug auf Transparenz, Risikomanagement und Urheberrechtskonformität. Die Europäische Kommission wird zudem Leitlinien zur praktischen Umsetzung bereitstellen, insbesondere für die Überwachung von KI-Systemen nach ihrem Markteintritt.

Mit dem 2. August 2026 wird der EU AI Act weitgehend in voller Breite in Kraft treten. Ab dann müssen vor allem Hochrisiko-Systeme sämtliche regulatorische Vorgaben erfüllen. Parallel dazu müssen alle Mitgliedstaaten sogenannte KI-Regulierungs-Sandboxes etablieren, in denen Unternehmen neue Systeme unter behördlicher Aufsicht testen können.

Ab 2027 folgen weitere Pflichten für KI-Systeme, die bereits Teil regulierter Produkte sind. Anbieter von KI-Modellen, die schon vor Inkrafttreten der Verordnung auf dem Markt waren, müssen bis dahin vollständig konform sein. Für besonders komplexe oder groß angelegte Systeme gelten Übergangsfristen bis Ende 2030.

Diese Entwicklungen zeigen: Der EU AI Act wird Unternehmen noch viele Jahre begleiten und eine vorausschauende Planung, robuste Governance-Strukturen und die Fähigkeit, sich an fortlaufende regulatorische Weiterentwicklungen anzupassen, erfordern.

Fazit: 2026 wird zum entscheidenden Jahr für KI-Compliance

Der Blick auf die bevorstehenden regulatorischen Meilensteine zeigt deutlich, dass das Jahr 2026 für Unternehmen zu einer Schlüsselphase im Umgang mit KI wird. Nachdem sich die Technologie in den letzten Jahren rasant etabliert und deutliche geschäftliche Vorteile geschaffen hat, verschieben sich die Prioritäten nun klar in Richtung Regulierung, Governance und Risikomanagement.

Die Vorgaben des EU AI Acts treten 2026 in ihre entscheidende Phase: Hochrisiko-Systeme müssen ab August vollständig konform sein, GPAI-Anbieter und -Anwender stehen vor konkreten Transparenz- und Risikopflichten und die Aufsichtsbehörden beginnen, ihre neuen Befugnisse aktiv auszuüben.

Unternehmen müssen nun den Spagat zwischen Innovation und Regulierung meistern. Sie sollten deshalb KI-Governance fest verankern, Risiken frühzeitig bewerten, Dokumentation und Kompetenzen stärken und sich aktiv auf kommende Prüfungen vorbereiten. Wer 2026 proaktiv handelt, schafft nicht nur regulatorische Sicherheit, sondern legt auch die Grundlage für einen nachhaltigen, verantwortungsvollen Einsatz von KI.

Sie müssen sich anmelden, um einen Kommentar zu schreiben.